พารามิเตอร์ (Parameter) ใน AI คืออะไร? บทความนี้จะพาคุณไปหาคำตอบว่าทำไมโมเดล AI ที่มีพารามิเตอร์มหาศาลถึงมีความฉลาดและเข้าใจภาษามนุษย์ได้ดีกว่า พร้อมเจาะลึกการทำงานแบบเข้าใจง่าย

หากคุณติดตามข่าวสารในวงการไอทีและเทคโนโลยีในช่วงปีที่ผ่านมา คุณน่าจะได้ยินบริษัทยักษ์ใหญ่เปิดตัวปัญญาประดิษฐ์ (AI) หรือ Large Language Models (LLMs) รุ่นใหม่ๆ พร้อมกับตัวเลขที่มักจะถูกนำมาขิงกันเสมอ นั่นคือ “จำนวนพารามิเตอร์” (Parameters) เช่น โมเดลนี้มี 7 พันล้านพารามิเตอร์ หรือโมเดลนั้นมีทะลุ 1 ล้านล้านพารามิเตอร์ไปแล้ว

สำหรับผู้อ่านเว็บ Numsai Tech ที่อาจจะยังสงสัยว่า ตัวเลขหลักพันล้านหรือล้านล้านนี้มันคืออะไรกันแน่? วันนี้เราจะมาเจาะลึกโครงสร้างข้อมูลเบื้องหลังความฉลาดของ AI กันครับ ว่าพารามิเตอร์คืออะไร และทำไม “ยิ่งเยอะ ถึงยิ่งดูเหมือนจะฉลาดขึ้น”

พารามิเตอร์ (Parameter) ในโลกของ AI คืออะไร?

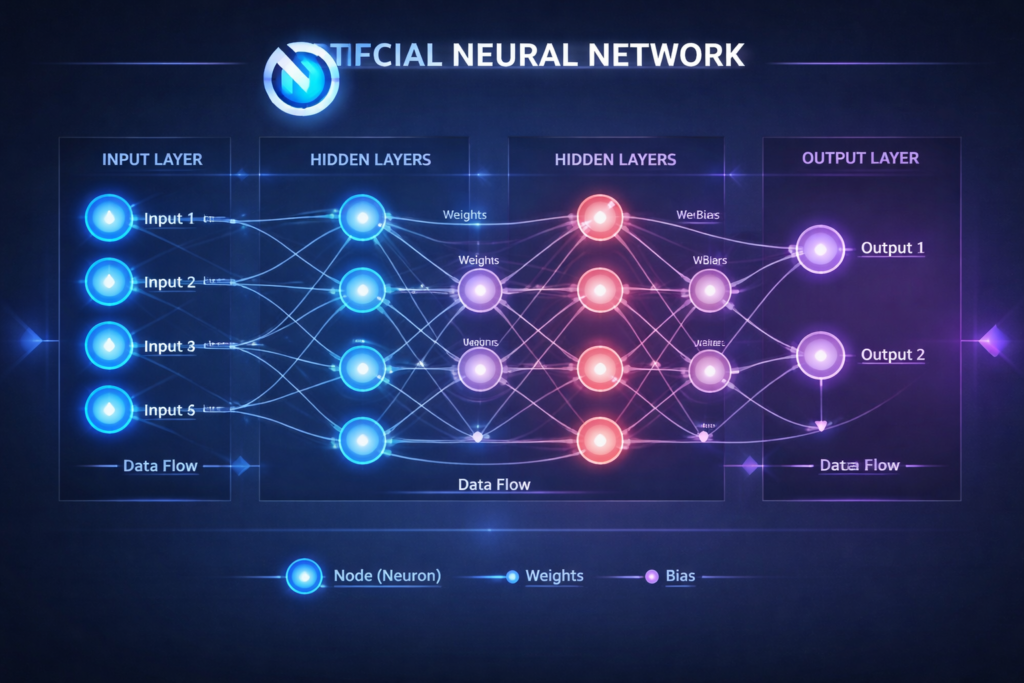

ในการทำความเข้าใจพารามิเตอร์ เราต้องมองเข้าไปในสมองของ AI ก่อน ซึ่งส่วนใหญ่ในปัจจุบันทำงานด้วยสถาปัตยกรรมที่เรียกว่า โครงข่ายประสาทเทียม (Artificial Neural Networks) ซึ่งถูกออกแบบเลียนแบบการทำงานของเซลล์ประสาทในสมองมนุษย์

ภายในโครงข่ายประสาทเทียมนี้ จะประกอบไปด้วย “โหนด” (Nodes) หรือ “เซลล์ประสาทเทียม” จำนวนมากที่เชื่อมต่อเข้าด้วยกัน แต่ละเส้นทางการเชื่อมต่อเหล่านั้นจะมี “ค่าน้ำหนัก” (Weights) และ “ค่าความลำเอียง” (Biases) ซ่อนอยู่

ค่าน้ำหนักและค่าความลำเอียงนี่แหละครับ คือสิ่งที่เราเรียกรวมๆ ว่า “พารามิเตอร์ (Parameter)”

เพื่อให้เห็นภาพง่ายขึ้น ลองจินตนาการว่าโครงข่ายประสาทเทียมคือ แผงควบคุมมิกเซอร์เสียง (Audio Mixer) ขนาดยักษ์

- ข้อมูลที่คุณป้อนเข้าไป (Input) คือเสียงร้องและเสียงดนตรีดิบๆ

- พารามิเตอร์ (Parameters) คือ “ปุ่มหมุน” และ “สไลเดอร์” นับพันล้านปุ่มบนแผงควบคุมนั้น

- ผลลัพธ์ (Output) คือเพลงที่มิกซ์ออกมาได้อย่างสมบูรณ์แบบและไพเราะ

ในช่วงที่ AI กำลัง “เรียนรู้” (Training Phase) มันจะทำการหมุนปุ่มพารามิเตอร์เหล่านี้ไปเรื่อยๆ ลองผิดลองถูก ปรับจูนค่าน้ำหนักจนกว่าผลลัพธ์ที่ได้จะมีความแม่นยำที่สุด เมื่อมันเรียนรู้เสร็จแล้ว ปุ่มหมุนเหล่านี้จะถูกล็อกค่าไว้ และพร้อมนำไปใช้งานจริง (Inference)

ทำไม AI ที่มีพารามิเตอร์ “เยอะ” ถึง “ฉลาด” กว่า?

คำตอบสั้นๆ คือ “ยิ่งมีปุ่มให้ปรับจูนเยอะ AI ก็ยิ่งสามารถจัดการกับความซับซ้อนของข้อมูลได้ละเอียดมากขึ้น” เมื่อเราพูดถึงการประมวลผลภาษามนุษย์ โครงสร้างข้อมูล ไอที หรือแม้แต่การเขียนโค้ดซอฟต์แวร์ระดับสูง ทุกสิ่งไม่ได้เรียบง่ายและขึ้นกับสถานการณ์ที่เปลี่ยนไป การมีพารามิเตอร์ที่เยอะขึ้นส่งผลดีดังนี้ครับ

1. ความสามารถในการจดจำและเรียนรู้รูปแบบ (Pattern Recognition)

โมเดลที่มีพารามิเตอร์จำนวนมาก เปรียบเสมือนสมองที่มีความจุสูง มันสามารถจดจำรูปแบบ (Pattern) ของโครงสร้างภาษา ไวยากรณ์ ข้อมูลเชิงเทคนิค และความรู้ทั่วไปจากชุดข้อมูลมหาศาลที่มันถูกเทรนมาได้อย่างแม่นยำ ทำให้มันสามารถตอบคำถามเชิงลึกได้ดีกว่า

2. ความเข้าใจสถานการณ์รอบด้านและความหมายลึกซึ้ง (Contextual Understanding)

ภาษามนุษย์มีความกำกวมสูง คำหนึ่งคำอาจแปลได้หลายความหมายขึ้นอยู่กับบริบท โมเดลที่มีพารามิเตอร์น้อยอาจแปลความหมายตรงตัวแบบทื่อๆ แต่โมเดลระดับหมื่นล้านพารามิเตอร์ขึ้นไป จะมี “ปุ่มหมุน” มากพอที่จะเข้ารหัส (Encode) และทำความเข้าใจบริบท อารมณ์ ความประชดประชัน หรือแม้แต่ตรรกะที่ซับซ้อนได้

3. ความยืดหยุ่นในการทำงาน (Versatility)

สังเกตไหมครับว่า AI ยุคใหม่ไม่ได้ทำได้แค่ตอบคำถาม แต่ยังสามารถแต่งกลอน เขียนโค้ดภาษา Python สรุปบทความ และแปลภาษาได้ในตัวเดียว ความสามารถแบบ Multi-tasking แบบนี้ จำเป็นต้องพึ่งพาเครือข่ายพารามิเตอร์ที่ใหญ่และลึกซึ้ง (Deep Learning) เพื่อแบ่งแยกทักษะแต่ละด้านออกจากกันภายในโมเดลเดียว

พารามิเตอร์ยิ่งเยอะ ยิ่งดีเสมอไปหรือไม่? (ข้อควรระวัง)

แม้ว่าพารามิเตอร์ที่เยอะจะนำมาซึ่งความสามารถที่น่าทึ่ง แต่ในมุมมองของวิศวกรรมคอมพิวเตอร์และฮาร์ดแวร์แล้ว “ใหญ่กว่าไม่ได้แปลว่าดีที่สุดเสมอไป” เสมอไปครับ เพราะมันมาพร้อมกับข้อจำกัดดังนี้:

- กินทรัพยากรฮาร์ดแวร์ (Hardware Intensive) โมเดลที่มีพารามิเตอร์ระดับ 100 พันล้านตัว จำเป็นต้องใช้การ์ดจอ (GPU) ระดับเซิร์ฟเวอร์หลายสิบหรือหลายร้อยตัวในการประมวลผล ซึ่งกินไฟและมีต้นทุนมหาศาล

- ความล่าช้าในการตอบสนอง (Latency) ยิ่งมีปุ่มให้ประมวลผลเยอะ เวลาที่คุณกดส่งคำถาม AI ก็ต้องใช้เวลาในการวิ่งผ่านพารามิเตอร์เหล่านั้นนานขึ้น

- Overfitting หากโมเดลมีขนาดใหญ่เกินไปแต่ชุดข้อมูลที่ใช้สอนมีน้อย โมเดลอาจจะใช้วิธี “ท่องจำ” ข้อมูลแทนที่จะ “ทำความเข้าใจ” ทำให้เมื่อเจอข้อมูลใหม่ๆ ที่ไม่เคยเห็น มันจะทำงานผิดพลาดได้

ในปัจจุบัน วงการไอทีและ AI จึงเริ่มหันมาโฟกัสที่การทำ Optimization หรือการสร้างโมเดลที่มีขนาดเล็กลง (หลักพันล้านพารามิเตอร์) แต่ปรับจูนค่าน้ำหนักและโครงสร้างข้อมูลให้มีประสิทธิภาพสูงสุด เพื่อให้สามารถรันบนคอมพิวเตอร์พีซี หรือแม้แต่สมาร์ทโฟนทั่วไปได้นั่นเอง

บทสรุป

พารามิเตอร์ (Parameter) คือหัวใจสำคัญที่กำหนดว่า AI โมเดลนั้นๆ จะมีความสามารถในการเรียนรู้และแก้ปัญหาได้ลึกซึ้งเพียงใด การที่โมเดลมีพารามิเตอร์เยอะ ก็เปรียบเสมือนการมีเครื่องมือที่ละเอียดอ่อนและทรงพลังมากขึ้นในการถอดรหัสความซับซ้อนของโลกใบนี้

ติดตามบทความเจาะลึกเรื่องเทคโนโลยี ซอฟต์แวร์ และปัญญาประดิษฐ์ที่เข้าใจง่ายแบบนี้ได้เสมอที่ Numsai.com แหล่งรวมความรู้ไอทีสำหรับคุณครับ!